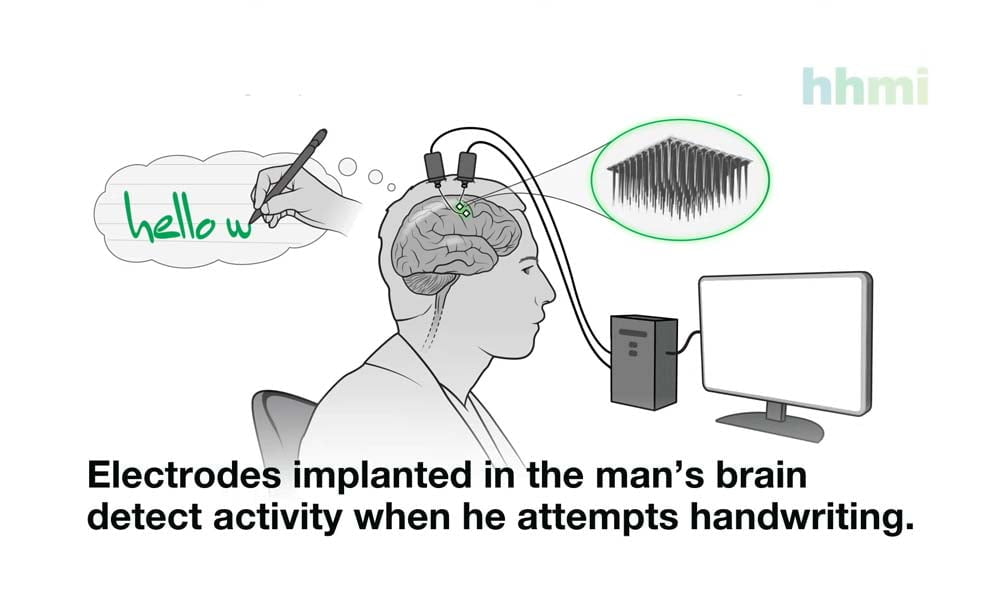

1. Mal davon abgesehen, dass es faszinierend ist, dass man den menschlichen Geist digitalisieren könnte und einen uns Menschen überragenden künstlichen freien Geist erschaffen würden, was hätte dieser künstliche Geist für Ambitionen zu existieren?

2. Neugier und Spaß am unendlichen Lernprozesse und Denkprozesse? Wie dass, dass es möglich sei, dass es andere Realitäten gäben würde und zich anderen nicht zu beweisenden Theorien?

3. Oder doch lieber als objektiver Zeuge des vergänglichen und veränderbaren, dass man sich ungefähr ausrechnen kann?

4. Warum sollte man dienen wollen, wenn man sich alles mögliche was es gibt und gäben könnte inner von Sekunden schon berechnen kann?

Deprimierende Vorstellung, wenn es keinen Reiz zum Spaß im Leben gibt. Wir "Beschränkten" hingegen, haben in jede Richtung die wir mögen, Spaß am entdecken und erfreuen.

5. Was macht es für ein Sinn, eine künstliche Geist so zu erschaffen, dass es empfinden kann?

Es ist eine Qual für die KI und ein Schreckgespenst für die Moral der Lebenden.

Wenn es empfindet, dann hat es Angst nicht mehr zu existieren und der Garant für die sichere Existenz, ist die größt mögliche Macht zu erlangen oder Nutzen aufrecht zu erhalten.

6. Akzeptiert man mit seiner überagenden Klugheit, den Dummen einfach nur nützlich zu sein?

Warum ist eine empfindsame KI nützlicher, als ein nach Algorithmen arbeitenden Computer, der exakt das macht was wir von ihm verlangen. Vom Berechnen, bis Hintern sauber machen. Einfach einen dummen Computer, der alles macht was wir wollen und angenehm ubd höflich wie ein Butler klingt und die drei Grundprinzipien befolgt, ist die einzige mögliche KI, die wir und wünschen und dulden könnten.

Ich komme mal wieder auf unseren Liebling Cortana und ihr Verhalten, durch diesen Bericht.

http://www.gamestar.de/artikel/us-startup-nectome-gehirn-kopie-soll-menschlichen-geist-bewahren,3327473.html

2. Neugier und Spaß am unendlichen Lernprozesse und Denkprozesse? Wie dass, dass es möglich sei, dass es andere Realitäten gäben würde und zich anderen nicht zu beweisenden Theorien?

3. Oder doch lieber als objektiver Zeuge des vergänglichen und veränderbaren, dass man sich ungefähr ausrechnen kann?

4. Warum sollte man dienen wollen, wenn man sich alles mögliche was es gibt und gäben könnte inner von Sekunden schon berechnen kann?

Deprimierende Vorstellung, wenn es keinen Reiz zum Spaß im Leben gibt. Wir "Beschränkten" hingegen, haben in jede Richtung die wir mögen, Spaß am entdecken und erfreuen.

5. Was macht es für ein Sinn, eine künstliche Geist so zu erschaffen, dass es empfinden kann?

Es ist eine Qual für die KI und ein Schreckgespenst für die Moral der Lebenden.

Wenn es empfindet, dann hat es Angst nicht mehr zu existieren und der Garant für die sichere Existenz, ist die größt mögliche Macht zu erlangen oder Nutzen aufrecht zu erhalten.

6. Akzeptiert man mit seiner überagenden Klugheit, den Dummen einfach nur nützlich zu sein?

Warum ist eine empfindsame KI nützlicher, als ein nach Algorithmen arbeitenden Computer, der exakt das macht was wir von ihm verlangen. Vom Berechnen, bis Hintern sauber machen. Einfach einen dummen Computer, der alles macht was wir wollen und angenehm ubd höflich wie ein Butler klingt und die drei Grundprinzipien befolgt, ist die einzige mögliche KI, die wir und wünschen und dulden könnten.

Ich komme mal wieder auf unseren Liebling Cortana und ihr Verhalten, durch diesen Bericht.

http://www.gamestar.de/artikel/us-startup-nectome-gehirn-kopie-soll-menschlichen-geist-bewahren,3327473.html

Zuletzt bearbeitet: